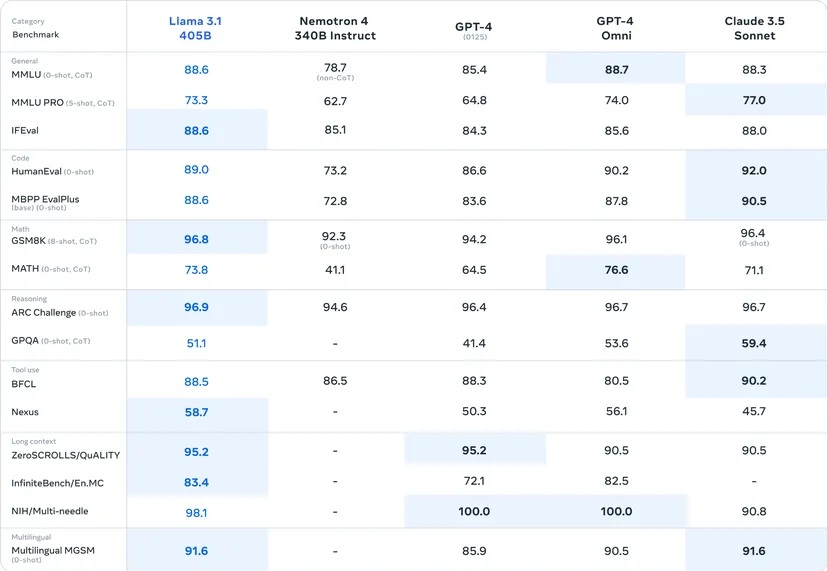

Mark Zuckeberg è convinto che Meta AI sarà il chatbot più utilizzato entro la fine del 2024 e il lancio di Llama 3.1 sembra confermare questa previsione. Stiamo parlando del modello di intelligenza artificiale più grande mai realizzato che secondo diversi benchmark supera sia GPT-4o di OpenAI che Claude 3.5 Sonnet di Anthropic. Tra gli aspetti interessanti di questo modello è che è completamente open source.

Meta Llama 3.1: caratteristiche e dettagli

Come annunciato lo scorso aprile Meta ha realizzato (e ora ha iniziato a diffonderlo) un modello di intelligenza artificiale che rappresenta una novità assoluta per questo settore. Tanto per rendere l’idea Llama 3.1 è nettamente più complesso dei modelli Llama 3 usciti pochi mesi fa e la versione più grande è stata addestrata con oltre 16000 delle GPU H100 di Nvidia. Meta non ha rilasciato dettagli sui costi dell’operazione ma è molto probabile che siamo nell’ordine di centinaia di milioni di euro.

Perché, allora, renderlo open source? Lo stesso Zuckeberg, in un post sul blog di Meta, ha paragonato l’impatto di questo modello di intelligenza artificiale a Linux e a come questo sistema operativo è diventato uno dei principali sistemi operativi. Da Meta sono convinti che i modelli open source miglioreranno più velocemente rispetto ai modelli proprietari.

Questo modello di intelligenza artificiale sta rendendo disponibile l’assistente Meta AI in diversi Paesi e lingue. Per sostenere la diffusione di Llama 3.1 Meta sta collaborando con aziende del calibro di Amazon, Microsoft, Google e Nvidia e sta iniziando a rilasciarlo così che le aziende possano addestrarlo su dati specifici e ottimizzarlo secondo le proprie esigenze.

Mentre Meta non spiega quali siano stati i dati utilizzati per addestrare Llama 3.1 (probabilmente anche per evitare le cause legali in materia di copyright cui diversi competitor sono andati incontro negli ultimi mesi) è possibile iniziare a vederne l’implementazione come chatbot su Instagram, Facebook e WhatsApp. Da questa settimana, infatti, Llama 3.1 sarà accessibile per la prima volta negli Stati Uniti tramite il sito web Meta AI e WhatsApp per poi proseguire con Facebook e Instagram.

Tra le funzionalità che sarà possibile utilizzare in Meta Ai c’è quella Imagine Me con cui scansionare il volto di una persona tramite la fotocamera dello smartphone e creare un’immagine basata su quella foto. Si può chiedere al chatbot qualcosa come “immaginami come un re”, “immaginami in un dipinto surrealista” o, ancora, “immaginami in vacanza al mare” e ottenere la relativa immagine.

Nelle prossime settimane Meta AI arriverà anche sulle cuffie Quest sostituendo l’interfaccia di comando vocale.

I nostri contenuti da non perdere:

- 🔝 Importante: MediaWorld lancia i Club Days: fino a 500 euro di sconto su tanti prodotti tech

- 💻 Troppi portatili al Black Friday? Andate sul sicuro con queste offerte MSI

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo