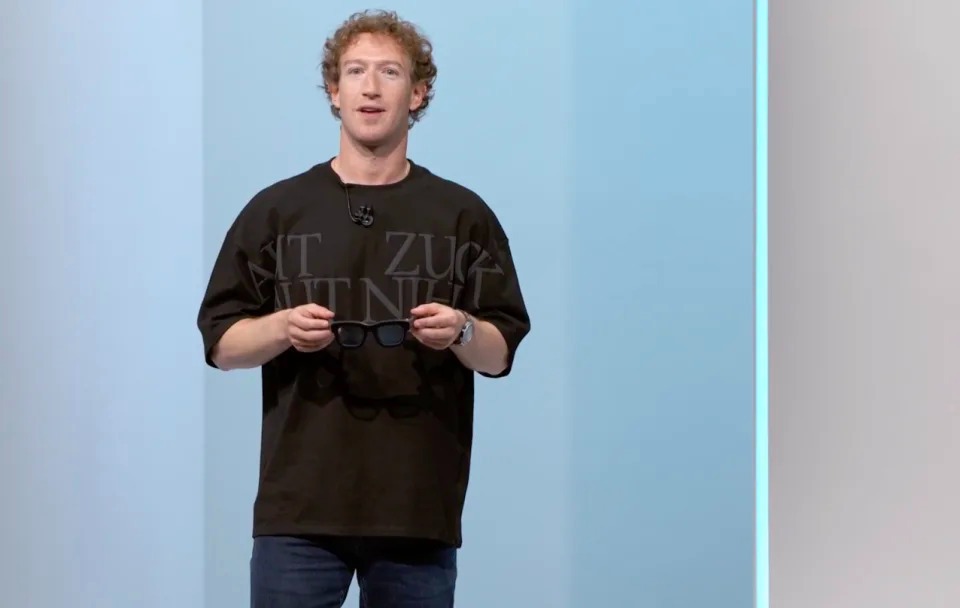

Nel corso del keynote inaugurale di Meta Connect 2024 sono state annunciate diverse novità come Meta Quest 3S e Project Orion, ma non è mancato lo spazio per le novità legate all’intelligenza artificiale. Tra i protagonisti dell’evento troviamo infatti anche Meta Ai, sempre più utilizzata in tutto il mondo, e Llama, il modello linguistico di Meta che è arrivato alla versione 3.2.

Le novità di Meta AI

La prima grande novità annunciata alla Meta Connect 2024 è sicuramente la possibilità di parlare con Meta AI utilizzando la propria voce, attraverso Messenger, Facebook, WhatsApp e nei messaggi diretti di Instagram. Basterà porre una qualsiasi domanda, senza doverla digitare sul proprio dispositivo, per ricevere una risposta, anche in questo caso vocale. La funzione sarà disponibile a breve e permetterà agli utenti di scegliere tra diverse voci per il proprio assistente vocale, scegliendo tra le versioni IA di quelle di alcuni personaggi famosi, come Awkwafina, Dame Judi Dench, John Cena, Keegan Michael Key e Kristen Bell.

Meta AI è ora in grado di rispondere a domande relative alle vostre foto, come ad esempio la ricerca degli scatti che contengono fiori, con l’IA che sarà in grado di indicarvi la specie del fiore o, nel caso di foto relative a una pietanza, potrete ottenere la ricetta per ricrearla a casa vostra. Se poi volete liberare la vostra fantasia e modificare una foto, vi basterà chiedere a Meta AI di farlo al posto vostro, per eliminare un elemento sullo sfondo o in primo piano, cambiare lo sfondo o aggiungere un elemento mancante. Per i più pigri sarà possibile farsi aiutare dall’intelligenza artificiale per creare una storia divertente basandosi su una immagine che avrete scelto.

Una novità molto utile per i creatori di contenuti riguarda invece la traduzione degli audio nei Reels, attualmente in fase di test, così da consentire a chiunque, anche a chi non parla la lingua utilizzata nel video, di godersi il contenuto nel proprio idioma. E Meta AI non si limiterà a tradurre l’audio ma si occuperà anche di sincronizzare il movimento delle labbra con la nuova lingua, così da garantire un effetto finale davvero realistico.

La funzione di generazione di immagini si espande ulteriormente e arriva sulle Storie e nelle immagini di profilo di Facebook, con Meta AI che vi suggerirà anche il testo più adatto a ciascuna. E su Messenger e nei messaggi diretti di Instagram potete cambiare il tema così da avere uno sfondo e le bolle dei messaggi diverse per ciascuna chat, per renderle ancora più riconoscibili.

Meta non pensa solo all’intrattenimento ma propone nuove soluzioni di IA anche per le attività. Per le attività che utilizzano le pubblicità tramite messaggi su WhatsApp in lingua inglese, arriva l’IA che permette di rispondere alle domande relative ai prodotti ed è in grado di condurre l’utente fino all’acquisto finale, aumentando così le vendite e l’interesse.

Le funzioni generative dell’IA sono sempre più utilizzate e solo nello scorso mese di agosto sono state creati più di 15 milioni di annunci pubblicitari che hanno portato a un maggior numero di click e a una percentuale di conversione delle vendite più alta rispetto a quelle campagne che non utilizzano l’IA.

Nuovi modelli per Llama 3.2

Nella giornata di ieri inoltre meta ha annunciato Llama 3.2, che include modelli linguistici di piccole e medie dimensioni e nuovi modelli testuali pensati per essere utilizzati direttamente su dispositivi mobili. In particolare i nuovi modelli Llama 3.2 1B e 3B sono ottimizzati per i dispositivi che utilizzano chipset Qualcomm e MediaTek e per i processori ARM.

I modelli Llama 3.2 11B e 90B invece vanno a sostituire i corrispondenti modelli testuali, migliorando nella comprensione delle attività legate alle immagini rispetto ai modelli chiusi come, ad esempio, Claude 3 Haiku. I nuovi modelli Llama possono essere regolati in maniera dettagliata per applicazioni personalizzate.

Meta ha inoltre rilasciato le specifiche dell’API Llama Stack, così da semplificare il lavoro degli sviluppatori nell’utilizzo dei modelli Llama in vari ambienti, sia in cloud che sui dispositivi. La compagnia californiana ha lavorato a stretto contatto con alcuni partner come AWS, Databricks, Dell Technologies, Fireworks, Infosys e Together AI per creare delle distribuzioni di Llama Stack dedicate ai clienti enterprise, continuando a condividere le proprie innovazioni con il mondo0. Questo perché Meta è convinta che l’apertura contribuisca a migliorare l’innovazione e sia una cosa buona per gli sviluppatori.

I nuovi modelli Llama 3.2 sono già scaricabili sul sito ufficiale e possono già essere impiegati per lo sviluppo sulle piattaforme dei partner di Meta, come AMD, AWS, Databricks, Dell, Google Cloud, Groq, IBM, Intel, Microsoft Azure, NVIDIA, Oracle Cloud e Snowflake, solo per citarne alcuni. Per maggiori dettagli vi rimandiamo al post ufficiale di Meta che illustra in maniera più approfondita le novità introdotte.

I nostri contenuti da non perdere:

- 🔝 Importante: Amazon regala 15 euro di credito: come approfittarne

- 💻 Troppi portatili al Black Friday? Andate sul sicuro con queste offerte MSI

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo