Gli occhiali smart sono sempre più una realtà e Meta è tra i produttori più attivi in questo campo avendo previsto anche diverse funzionalità AI per i suoi smart glasses. Parallelamente all’entusiasmo per questa nuova frontiera tecnologica c’è la forte, fortissima, preoccupazione sulle questioni legate alla privacy. Quanto fatto da due studenti di Harvard, AnhPhu Nguyen e Caine Ardayfio, sembra giustificare i timori in materia.

I pericoli nell’integrazione tra occhiali smart, LLM, database pubblici e motori di ricerca facciale

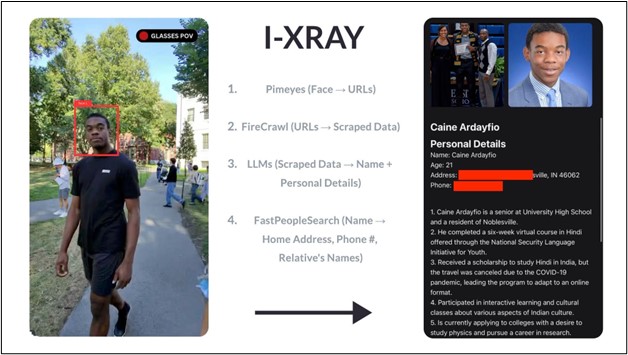

Molto “semplicemente”, indossando gli occhiali intelligenti di Meta e utilizzando uno dei più potenti motori di ricerca per il riconoscimento facciale come PimEyes è possibile individuare i dati personali (nome, indirizzo, numero di telefono) di una persona semplicemente guardandola. Il video qui sotto è molto più eloquente di tante parole.

Are we ready for a world where our data is exposed at a glance? @CaineArdayfio and I offer an answer to protect yourself here:https://t.co/LhxModhDpk pic.twitter.com/Oo35TxBNtD

— AnhPhu Nguyen (@AnhPhuNguyen1) September 30, 2024

I due studenti di Harvard hanno spiegato di aver collegato un paio di Ray-Ban di Meta a PimEyes, il motore di ricerca facciale invasivo, così da identificare degli estranei fotografati per strada tramite la ricerca sui vari database delle loro informazioni personali. A consentire questo risultato c’è stato l’utilizzo di un modello di linguaggio di grandi dimensioni (LLM) che combina rapidamente tutti i dati rendendo possibile identificare una persona senza che questa ne sia consapevole e favorevole a farsi riconoscere.

Grazie ai progressi dei modelli linguistici di grandi dimensioni e quelli di ricerca facciale è possibile raggiungere obiettivi che fino a poco tempo fa erano sostanzialmente impossibili o richiedevano risorse e tempi molto più lunghi. Fare una ricerca ne database pubblici per trovare informazioni partendo dall’immagine di una persona era fino a poco tempo fa molto difficile anche per le stesse forze di sicurezza. Oggi con la diffusione di questi sistemi e l’evoluzione tecnologica che consente di scattare foto ovunque senza (quasi) essere notati si possono trovare dati sensibili di chiunque.

I rischi sono evidenti. Dalla possibilità di scoprire dove abita una persona incontrata per strada alla pratica di diffondere informazioni personali e private di un soggetto senza il suo consenso con l’obiettivo di danneggiarlo. Senza ignorare come possibilità di questo tipo possano essere particolarmente ghiotte per fini criminali esponendo a serio rischio potenzialmente chiunque, soprattutto i bambini.

Lo strumento realizzato dagli studenti di Harvard con il quale è possibile realizzare queste ricerche è stato nominato I-XRAY e ha come obiettivo quello di dimostrare le attualità capacità degli occhiali intelligenti, dei motori di ricerca facciale, dei database pubblici e dei modelli linguistici di grandi dimensioni. Per questo motivo pur mostrando il possibile utilizzo di queste tecnologie non è stato rivelato il codice alla base del loro sistema.

Non è “colpa” di nessuno di questi singoli strumenti e tecnologie ma la loro integrazione rende possibili cose che sono estremamente pericolose e non si può ignorare il problema. La scelta degli occhiali Ray-Ban di Meta, hanno spiegato i due studenti di Harvard, è motivata dal fatto che questi occhiali sono quasi indistinguibili da quelli normali.

I test condotti (coprendo la luce che si accende in automatico quando si scattano foto e video con i Ray-Ban di Meta) hanno mostrato come sia estremamente semplice accedere alle informazioni personali di perfetti sconosciuti o di fingere una conoscenza accedendo a quel database di informazioni.

Al momento né Meta né Google hanno rilasciato tecnologie simili per collegare gli occhiali intelligenti ai motori di ricerca facciali, ma ci sono altre aziende che lo stanno facendo. È il caso di Clearview AI che utilizza un motore di ricerca facciale per le forze di polizia che ha come obiettivo quello di inserire ogni essere umano nel proprio database. Tanto che alcuni poliziotti hanno già utilizzato il sistema senza autorizzazione e Clearview è stata condannata a pagare una multa di 33 milioni di dollari per violazione della privacy.

Consapevoli dei possibili rischi di queste nuove tecnologie AnhPhu Nguyen e Caine Ardayfio hanno dato istruzioni su come rimuovere i propri volti dai motori di ricerca come PimEyes, Facecheck ID, CheckThem, FastPeopleSearch e Instant Checkmate.

L’altro aspetto interessante della vicenda è che le aziende coinvolte come Meta e PimEyes minimizzano i rischi per la privacy. Meta ha fatto sapere che non c’è nulla di nuovo nei suoi Ray-Ban in quanto i rischi sono gli stessi che si hanno con le foto, mentre PimEyes ha dichiarato che il suo motore di ricerca non identifica le persone ma indica solo i link alle loro foto. Risposte piuttosto elusive di un problema che esiste e che potrebbe diventare sempre più grave soprattutto negli Stati Uniti dove, a differenza dell’Unione europea, la raccolta di dati personali non richiede il consenso diretto della persona interessata.

I nostri contenuti da non perdere:

- 🔝 Importante: Notebook Black Friday 2024: le migliori offerte

- 🖥️ Intel Arrow Lake: analisi delle prestazioni, profili Intel, E-Core e tutto quello che dovete sapere

- 💰 Risparmia sulla tecnologia: segui Prezzi.Tech su Telegram, il miglior canale di offerte

- 🏡 Seguici anche sul canale Telegram Offerte.Casa per sconti su prodotti di largo consumo